Stattdessen sagt dieser Slogan weniger darüber aus, was das Unternehmen tut, als vielmehr darüber, warum es es tut. Die von Helsing Stellenanzeigen voller Idealismus und der Suche nach Menschen mit der Überzeugung, dass „demokratische Werte schützenswert sind“.

Die drei Gründer von Helsing bezeichnen die russische Invasion der Krim im Jahr 2014 als einen Weckruf dafür, dass ganz Europa bereit sein müsse, auf die russische Aggression zu reagieren. „Ich mache mir zunehmend Sorgen darüber, dass wir in unseren offenen Gesellschaften hinter die Schlüsseltechnologien zurückfallen“, sagt Reil. Dieses Gefühl verstärkte sich, als er 2018 zusah, wie Google-Mitarbeiter gegen einen Deal mit dem Pentagon protestierten, in dem Google dem Militär geholfen hätte, KI zur Analyse von Drohnenaufnahmen einzusetzen. Mehr als 4.000 Mitarbeiter haben eine Brief mit dem Argument, dass es moralisch und ethisch unverantwortlich sei, dass Google die militärische Überwachung und deren potenziell tödliche Folgen begünstige. Als Reaktion darauf erklärte Google, dass es den Vertrag nicht verlängern werde.

„Ich habe die Logik dahinter einfach nicht verstanden“, sagt Reil. „Wenn wir in offenen und freien Gesellschaften leben, sein wollen, wer wir sein wollen und sagen, was wir sagen wollen, müssen wir in der Lage sein, sie zu schützen.“ Wir können sie nicht als selbstverständlich betrachten.“ Er befürchtete, dass der Westen unweigerlich ins Hintertreffen geraten würde, wenn Big Tech mit all seinen Ressourcen von der Zusammenarbeit mit der Verteidigungsindustrie abgehalten würde. „Ich hatte das Gefühl, wenn sie es nicht tun, wenn die besten Google-Ingenieure nicht bereit sind, daran zu arbeiten, wer dann?“

Es ist normalerweise schwer zu sagen, ob Verteidigungsprodukte so funktionieren, wie ihre Entwickler es behaupten. Unternehmen, die es verkaufen, darunter auch Helsing, behaupten, dass eine Transparenz der Details die Wirksamkeit ihrer Tools beeinträchtigen würde. Aber während wir sprechen, versuchen die Gründer, ein Bild davon zu vermitteln, was ihre KI mit den demokratischen Regimen kompatibel macht, an die sie verkaufen möchte. „Wir legen großen Wert auf Privatsphäre und Freiheit und würden niemals Dinge wie Gesichtserkennung anwenden“, sagt Scherf und behauptet, dass das Unternehmen Militärs dabei helfen möchte, Objekte und nicht Menschen zu erkennen. „Es gibt bestimmte Dinge, die für den Verteidigungsauftrag nicht notwendig sind.“

Aber die schleichende Automatisierung in einer tödlichen Branche wie der Verteidigung wirft immer noch heikle Probleme auf. Wenn alle Helsing-Systeme eine erhöhte Aufklärung über das Gefechtsfeld bieten, die den Militärs hilft, zu verstehen, wo sich Ziele befinden, stellt das kein Problem dar, sagte Herbert Lin, leitender Forschungswissenschaftler am Center for International Security and Cooperation der Stanford University. Sobald dieses System jedoch eingerichtet ist, glaubt er, werden die Entscheidungsträger unter Druck geraten, es mit autonomen Waffen zu verbinden. „Politische Entscheidungsträger sollten dieser Idee widerstehen“, sagt Lin und fügt hinzu, dass Menschen und nicht Maschinen zur Verantwortung gezogen werden sollten, wenn Fehler passieren. Wenn KI eher einen Traktor als einen Lastwagen oder einen Panzer tötet, ist das schlecht. Wer soll dafür verantwortlich gemacht werden?“

Riel besteht darauf, dass Helsing keine autonomen Waffen herstellt. „Wir machen das Gegenteil“, sagt er. „Wir entwickeln KI-Systeme, die den Menschen helfen, die Situation besser zu verstehen.“

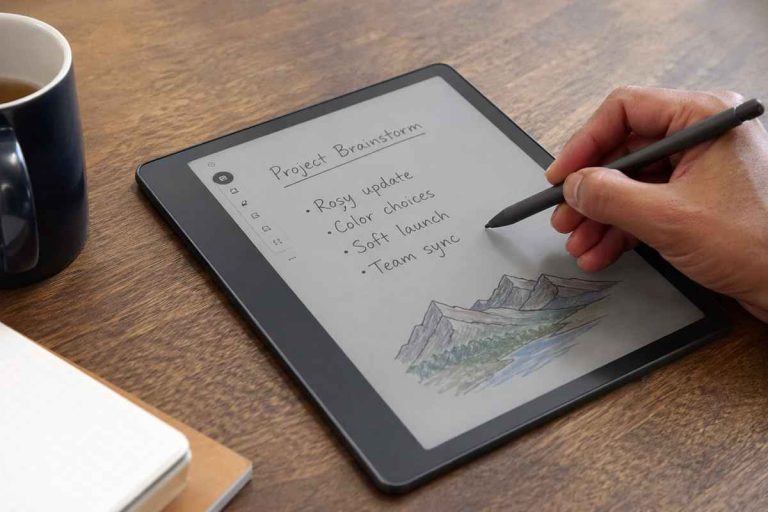

Obwohl Bediener die Plattform von Helsing nutzen können, um eine Drohne abzuschießen, ist es derzeit ein Mensch, der diese Entscheidung trifft, nicht die KI. Es stellt sich jedoch die Frage, wie viel Autonomie Menschen tatsächlich haben, wenn sie eng mit Maschinen zusammenarbeiten. „Je weniger man den Benutzern die Werkzeuge erklärt, mit denen sie arbeiten, desto mehr behandeln sie sie wie Zauberei“, sagt Jensen vom Center for Strategic and International Studies und behauptet, dies bedeute, dass militärische Benutzer der KI zu sehr oder zu wenig vertrauen könnten.

Schöpfer. Hipster-freundlicher Unternehmer. Student. Freundlicher Analyst. Professioneller Schriftsteller. Zombie-Guru. Amateur-Web-Nerd.

+ There are no comments

Add yours